数据中心的能耗焦虑, 到底有没有最优解?

2022年06月28日

评论数(0)

算力正在进入“基建化”的时代。

几年前的时候,每当电商大促、春晚红包等节点,宕机和救火几乎是从不缺席的戏份。近两年却是另一番景象:即便是在618大促这样的流量波峰,大多数电商平台都顶住了高并发的压力,背后离不开算力的迅猛增长。

正如中国信通院在一份研究报告中所揭示的:2016年到2020年期间,中国的算力规模平均每年增长42%,其中2020年的算力总规模已经达到135EFlops,并仍在保持55%的高速增长。

只是算力高速增长的同时,也带来了新的问题。

01 计算与散热的“零和博弈”

对于不少人来说,“计算”早已不是什么新概念。每一次打开“绿码”、每一次视频会议、每一次搜索点击……都离不开数据中心的处理计算。“计算”在日常生活中的无缝渗透,勾勒出了多彩的数字世界。

可当计算量越来越大,产生的功耗也随之增大。以全球最为知名的预训练大模型GPT-3为例,一次训练要消耗巨量的算力,需要消耗约19万度的电力,产生85万吨的二氧化碳,将其形容为“耗电怪兽”绝不为过。

倘若这些电力用在了“计算”本身,或许不是什么坏消息。毕竟在数字经济的时代,有一个著名的经济学解释,即算力上每投入一元,将带动3-4元的经济产出,“性价比”远高于传统的农牧业和工业生产。

现实的情况却并不乐观。根据开源证券研究所的统计结果,一个数据中心的能耗分布中,散热系统的占比高达40%。也就是说,数据中心每耗费一度电,只有一半用在了“计算”上,其他的则浪费在了散热、照明等方面。计算和散热几乎陷入了一场零和博弈,计算量越大散热消耗的电量越大,如果不消耗足够的能源提高散热能力,将直接影响数据中心的性能、密度和可靠性。

行业内也由此流行起了PUE的概念,即电源使用效率,用来测算数据中心消耗的所有能源与IT负载消耗的能源的比值,被视为评价数据中心能源效率的重要指标,PUE值越接近1,表明非IT设备的耗能越少,数据中心的能效水平越高。目前国内大型数据中心的平均PUE值为1.55,超大型数据中心平均PUE值也只有1.46。

2020年时国内数据中心的用电量已经超过2000亿千瓦时,占到了用电总量的2.7%,预计2023年数据中心的能耗就将超过2500亿千瓦时,2030年时将超过4000亿千瓦时,用电量占比也将上升到3.7%。就这个角度而言,解决数据中心的能耗问题,已经是摆在案前的棘手挑战。

工信部在《新型数据中心发展三年行动计划(2021-2023年)》中,对数据中心的PUE进行了明确规定:2021年底新建大型及以上数据中心的PUE降低到1.35以下,到2023年时要低于1.3。北京、深圳等城市也对新建数据中心提出了严格要求,其中深圳已经发文鼓励PUE值低于1.25的数据中心。

联想到“碳达峰与碳中和”的时代背景,低PUE的“绿色计算”已经是不争的趋势。淘汰掉高耗能的组件,升级算力高、空间节省、碳排放低的新组件,已经是很多数据中心无法规避的现实问题。

02 被捧上神坛的“液冷”技术

在算力正在重塑产业格局的机遇面前,数据中心已然是无法拒绝的刚需,为数不多的选择在于提高算力效率并降低能耗,而能否找到新的散热方案,逐渐成为计算产业上下游必须应对的课题。

传统的散热方案以风冷为主,即将空气作为冷媒,把服务器主板、CPU等散发出的热量传递给散热器模块,再利用风扇或空调制冷等方式将热量吹走,也是散热系统消耗数据中心近半电力的主要诱因。

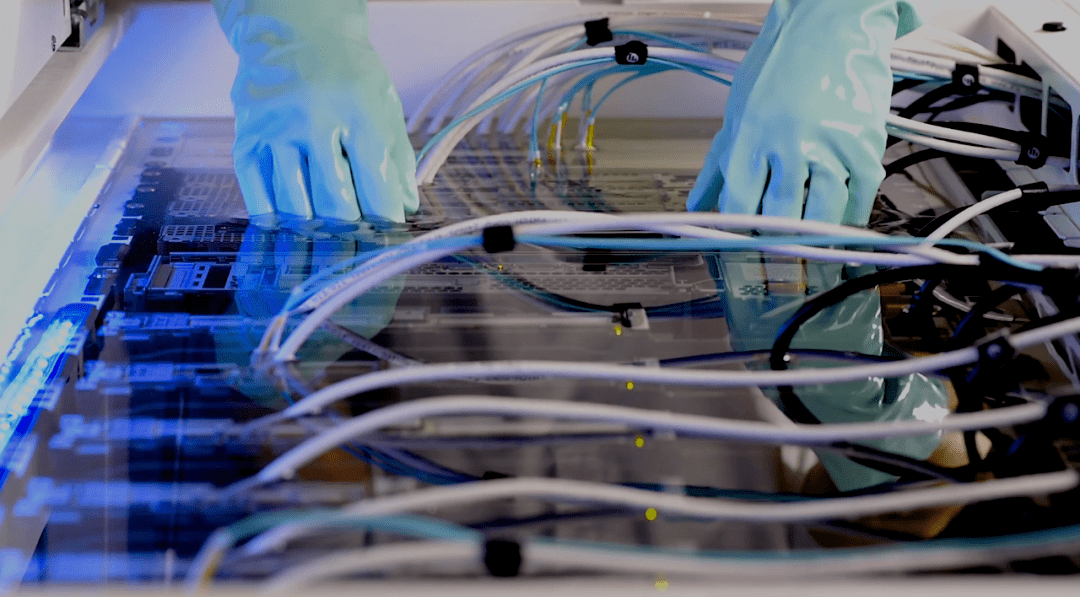

当PUE值被严格限定,绿色计算渐渐深入人心的时候,上世纪80年代就开始尝试的“液冷”技术,迅速成了产业上下游的新焦点。其实“液冷”技术的原理并不复杂,简单来说就是利用矿物油、氟化液等绝缘低沸点的冷却液作为冷媒,通过热交换将服务器的热量排出,并演变出了冷板式、喷淋式、浸没式等多种散热方案。

看似只是“冷媒”的改变,却为数据中心的节能降耗带来了诸多可能:

比如风冷热传导存在过程复杂、热阻总和大、换热效率较低等痛点,在很大程度上制约了数据中心的算力密度,并且常常会产生很大的噪声。液冷技术所呈现出的节能降耗、减少噪声、节约空间的特性,不可谓不诱人。

一个直接的例子就是普渡大学的Bell集群,10个机架的戴尔PowerEdge C6525 服务器直接浸没在冷却液中,运行时产生的热量直接被冷却液吸收,PUE最低可以降到1.05左右,散热所需的功耗比传统方案降低了90%以上。

再比如风冷想要提高散热能力,最“简单粗暴”的做法就是提高风扇转速,可把热量带出去的同时,风扇和硬盘间也会形成大的漩涡,不规则的湍流可能会影响硬盘的读写能力,甚至会因为磁头震动导致硬盘报废。

液冷技术近乎完美地规避了这些不利因素,由于液冷方案是一个相对静止的环境,可以有效降低由空气、灰尘和震动引起的硬件产品故障率,且数据中心始终在低温环境中运行,极大地提升了内部电子元器件的使用寿命。

可以看到的是,液冷技术的出现和应用,在很大程度上让计算和散热跳出了“囚徒困境”,对风冷降维打击的综合优势,也让液冷技术被不少人捧上神坛。然而和很多新技术一样,液冷方案同样存在天然短板:冷却液的价格堪比茅台,无形中增加了散热的硬性成本;液冷技术对数据中心的机房环境要求苛刻,重新改造的成本较高;液冷技术降低了PUE,运营成本却难言优势……

液冷是各种散热方案中毋庸置疑的翘楚,却也要考虑到现实的考量。

03 戴尔科技给出的最优解

就像国家发改委等部委在年初启动的“东数西算”工程,目的是将东部的算力需求转移到西部,堪比“南水北调”的工程量。除了国内东西部电力资源的不平衡,一个重要的因素就是对自然冷源的利用。

有机构曾经估算,即使是在现有的散热方案下,即使按照工业平均电价每千瓦时0.5元来计算,数据中心所在地的气温每降低1℃,10万台服务器的标准数据中心机房每天可节约9.6万元的电费。

这样的举措无疑向外界传递了一个清晰的信号:在液冷技术的价格居高不下的局面下,不可能在短时间内彻底取代风冷,现阶段需要的仍然是多元化的散热方案。挑战其实留给了大大小小的IT厂商,到底是All in 理想化的液冷,还是根植市场的现实诉求,推出多样性的解决方案?

在服务器市场牢牢占据一席之地的戴尔科技,已经给出了自己的答案。

外界普遍将风冷打入“冷宫”的时候,戴尔并未放弃风冷散热的技术创新,一边利用最佳的计算流体动力学CFD气流模拟技术来优化系统设计,一边推出了将数据中心的温暖废气循环到主空气调节的新风(Fresh Air)系统,结合最新的空气输送解决方案和先进的软件控制算法,刷新了风冷能耗的“成绩单”。

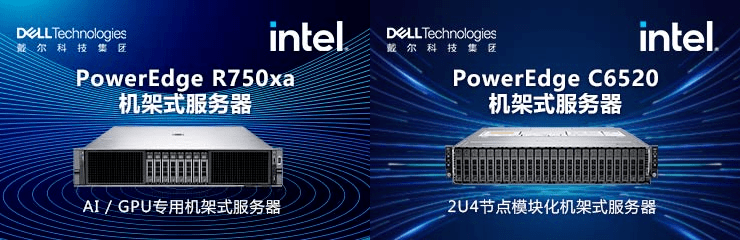

比如新一代戴尔PowerEdge系列产品R750,通过合理的散热布局减少过多气流,让服务器的散热能效比前代产品提高了60%,大大降低了工作流程中的能源消耗,同时避免了因过热导致服务器宕机、业务中断的尴尬。

哪怕是“传统”的风冷散热,戴尔的Fresh Air硬件冷却解决方案也让外界看到了新可能:在冬季为建筑设施提供“免费”的热量,在温暖月份直接将外部空气吸入数据中心,通过减少运行冷水机时间等方式,进一步降低了服务器的运营管理成本,PUE值同样有机会降低到1.05的水平。

而对于CPU功率超过150w的需求,戴尔科技针对不同的场景提供了冷板式和浸没式两种液冷技术:前者对应的例子有Triton液体冷却系统,将冷却液直接放入服务器sled冷却CPU,不仅带来了最高的冷却效率,还降低了冷却液的用量;PowerEdge C6520则是后者的典型代表,以闭环水流取代典型的金属散热器,使服务器能够同时支持高功率处理器和更高的机架密度。

戴尔科技的答案并不复杂,相比于对某种技术的过度依赖,戴尔科技的策略是针对客户需求提供不同散热方案的产品,再通过统一能耗管理软件OpenManage Power Center,提高了客户对服务器功耗的可见性和控制性,继而帮助客户低成本、自动化、智能化地应对各种能耗事件,找到适合自己的最优解。

04 写在最后

根据赛迪顾问的预测,2025年中国浸没式液冷数据中心的市场规模将超过526亿元,市场份额有望突破40%。

站在行业的立场上,液冷散热的高速普及不失为一个好消息。可对已有的数据中心运营者来说,绿色计算是一件等不得的事,存量的数据中心也需要提高散热能力,找到性能和散热间的新平衡;对于一些追求“性价比”的客户,降低PUE的渠道不应只有液冷散热一种,而是适合自己的产品和方案。

沿循这样的逻辑,提供多样化解决方案的戴尔科技,及其深入市场需求的理性思考,不失为借鉴和学习的对象。